60 વર્ષના એક અમેરિકન વ્યક્તિએ ChatGPT પાસેથી ખોરાકમાંથી મીઠું કેવી રીતે ઓછું કરવું તેની સલાહ માંગી. ChatGPTએ સોડિયમ ક્લોરાઇડની જગ્યાએ ઝેરી ગણાતા સોડિયમ બ્રોમાઇડનો ઉપયોગ કરવાની સલાહ આપી, જેના કારણે તેને 3 અઠવાડિયા હોસ્પિટલમાં રહેવું પડ્યું. જાણો આ આખી ઘટના અને AI મેડિકલ સલાહના જોખમો વિશે.

અમદાવાદ, સોમવાર

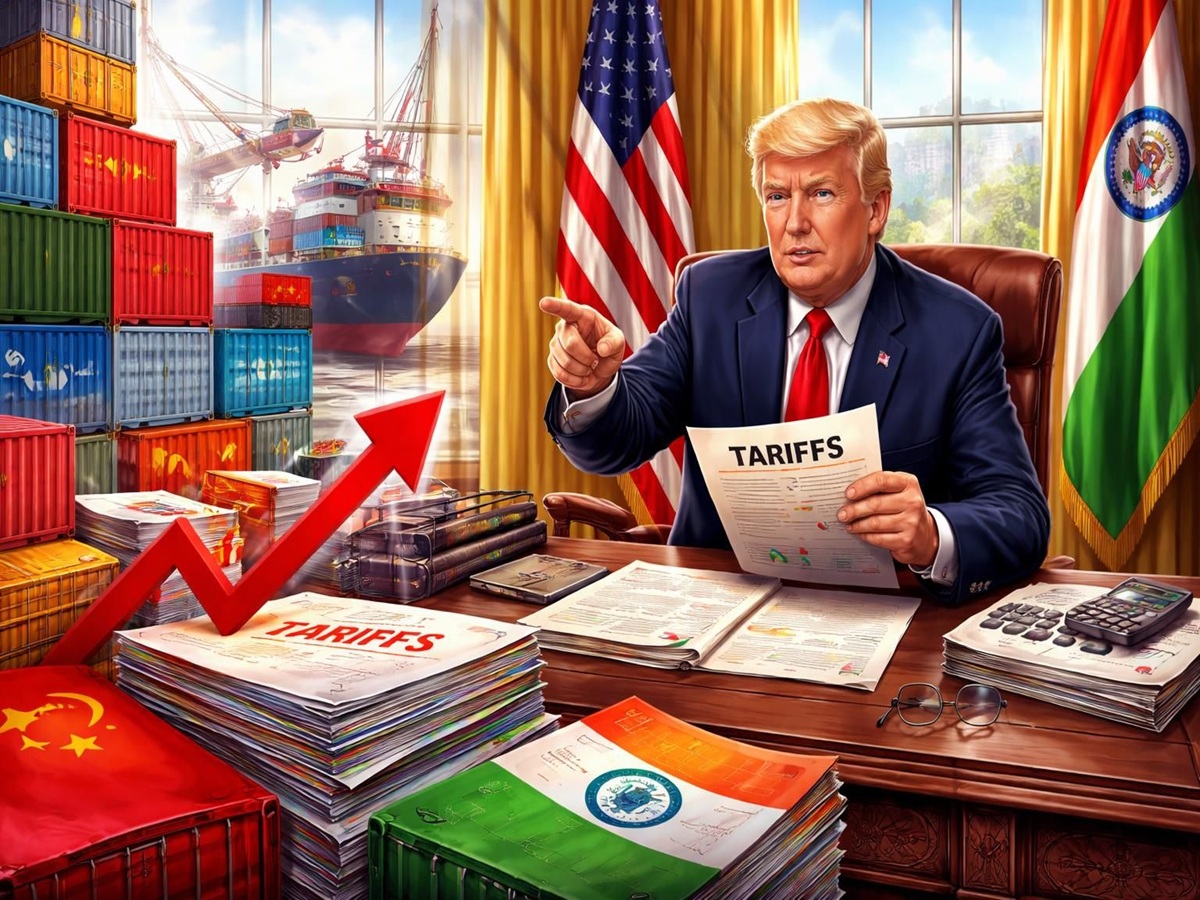

આજના ડિજિટલ યુગમાં, આર્ટિફિશિયલ ઇન્ટેલિજન્સ (AI) ટેક્નોલોજી રોજબરોજના જીવનનો એક ભાગ બની ગઈ છે. ખાસ કરીને ChatGPT જેવા AI મોડેલ આપણી ઘણી સમસ્યાઓનો ઉકેલ સરળતાથી લાવી આપે છે. પરંતુ, શું AIની દરેક સલાહ આંખો બંધ કરીને માની લેવી જોઈએ? ન્યૂ યોર્કમાં બનેલી એક ઘટનાએ આ સવાલ ફરીથી ઉભો કર્યો છે. એક 60 વર્ષના વ્યક્તિએ ChatGPTની મેડિકલ સલાહ માનીને ખોરાકમાં ઝેરી પદાર્થનો ઉપયોગ કર્યો અને તેને ગંભીર પરિણામો ભોગવવા પડ્યા.

ChatGPTની સલાહે ખતરો ઉભો કર્યો

આ ઘટનાની શરૂઆત ત્યારે થઈ જ્યારે એક વૃદ્ધ વ્યક્તિએ તેના ખોરાકમાંથી મીઠું (સોડિયમ ક્લોરાઇડ) કેવી રીતે દૂર કરવું તે વિશે ChatGPTને પૂછ્યું. ChatGPTએ તેને સોડિયમ બ્રોમાઇડનો ઉપયોગ કરવાની સલાહ આપી, જે 20મી સદીમાં દવામાં વપરાતો હતો પરંતુ હવે ઝેરી ગણાય છે. આ વ્યક્તિએ કોઈ ડોક્ટરની સલાહ લીધા વિના ChatGPTની સલાહ માની અને ઓનલાઈન સોડિયમ બ્રોમાઇડ ખરીદી લીધો. લગભગ 3 મહિના સુધી, તેણે પોતાના ખોરાકમાં મીઠાની જગ્યાએ આ પદાર્થનો ઉપયોગ કર્યો.

શરૂઆતમાં આ વ્યક્તિને કોઈ શારીરિક કે માનસિક બિમારી નહોતી. પરંતુ સોડિયમ બ્રોમાઇડના ઉપયોગ બાદ તેને ગંભીર સમસ્યાઓ થવા લાગી. તેને અતિશય ડર, ભ્રમ, સતત તરસ અને માનસિક મૂંઝવણ જેવી તકલીફો થવા માંડી. જ્યારે તેની હાલત ગંભીર બની ત્યારે તેને હોસ્પિટલમાં દાખલ કરવામાં આવ્યો. હોસ્પિટલમાં તપાસ દરમિયાન જાણવા મળ્યું કે તેને ‘બ્રોમાઇડ ટોક્સિસિટી’ થઈ હતી.

ત્રણ અઠવાડિયાની લાંબી સારવાર

હોસ્પિટલમાં ડોક્ટરોએ તરત જ તેની સારવાર શરૂ કરી. શરીરમાં પાણી અને ઇલેક્ટ્રોલાઇટ્સનું સંતુલન જાળવવા માટે ખાસ મેડિકલ પ્રોટોકોલનું પાલન કરવામાં આવ્યું. આખરે, ત્રણ અઠવાડિયાની સઘન સારવાર બાદ તેની હાલતમાં સુધારો થયો અને તેને હોસ્પિટલમાંથી રજા આપવામાં આવી.

આ ઘટના દર્શાવે છે કે, AI હજુ પણ મેડિકલ સલાહ માટે પૂરતું વિકસિત નથી. અમેરિકન કોલેજ ઓફ ફિઝિશિયન્સના જર્નલમાં પ્રકાશિત થયેલા આ કેસમાં સ્પષ્ટ ચેતવણી આપવામાં આવી છે કે, નિષ્ણાતોની સલાહ લીધા વિના AI પર ભરોસો કરવો હાનિકારક સાબિત થઈ શકે છે.